Sztuczna inteligencja

Mam wrażenie, że obecnie każda refleksja o AI bardzo szybko staje się banałem. Częściej jednak fałszem, kompletnie nietrafioną diagnozą. Dlatego do tematu sztucznej inteligencji zabierałam się jak pies do jeża. W końcu postanowiłam przyjrzeć mu się od strony Barbary.

Barbara mon amour

Barbara Ehrenreich to amerykańska pisarka i aktywistka, a także doktor immunologii komórkowej. Napisała wiele wspaniałych książek, ale szczególnie lubię jej “Z przyczyn naturalnych”. Zwróciła w niej uwagę na to, że opisy ludzkiego układu immunologicznego opierają się na metaforach walki i odwiecznej opozycji między siłami dobra (układu odpornościowego) a siłami zła (patogeny, komórki wirusów, bakterie). Jak to się ma do AI? Wydaje mi się, że na poziomie myślenia o sztucznej inteligencji obserwujemy bardzo podobny proces pojęciowy, tylko że wyposażony w inne metafory.

W tym poście pisałam o tym, że branżowy język IT jest napakowany metaforami zaczerpniętymi z różnych dziedzin życia. Począwszy od militariów (DMZ, firewall, payload) po szydełkowanie (threads) i kulinaria (lukier, spaghetti, kernel). Odkąd na scenie technologii króluje AI, branżowy język zalała niewyobrażalna do tej pory w naszej komputerowej banieczce fala antropomorfizmu.

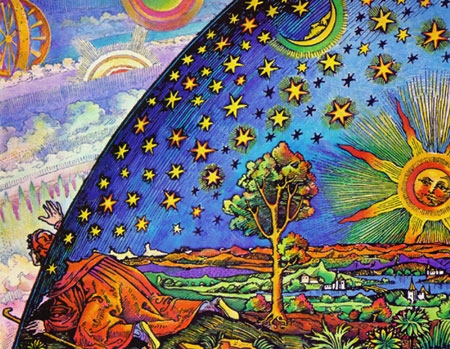

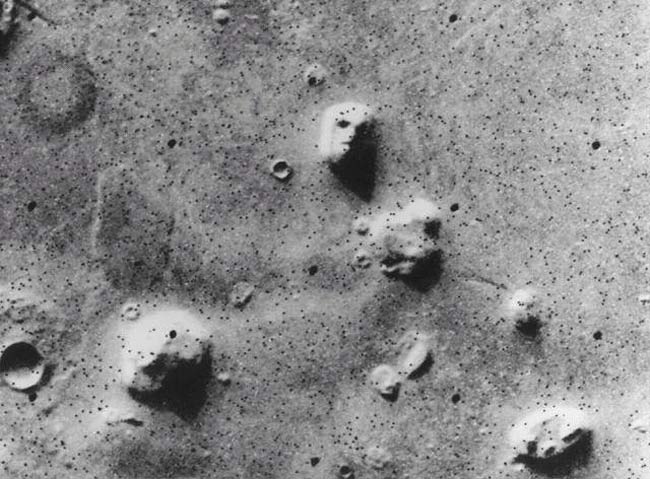

Antropomorfizm to przypisywanie cech typowo ludzkich wszystkiemu temu, co nie jest człowiekiem. Jest to zabieg znany nam z bajek (gadające misie, pieski), reklam (śpiewające parówki) czy z codziennego doświadczenia. Jesteśmy tylko ludźmi i najwidoczniej nasz mózg działa tak, że chce widzieć ludzkie cechy w przedmiotach i zjawiskach nieożywionych. To zjawisko otrzymało nawet swoją nazwę - pareidolia.

Mordeczka z Marsa

Już chyba wiadomo, do czego zmierzam. Wraz z popularyzacją AI do języka IT weszło mnóstwo metafor, które:

- dotyczą sfery mentalnej i psychicznej

- porównują funkcjonalności maszyn do podobnych cech u ludzi.

Nie jest to nic wyjątkowego. Termin, na którym stoi cała technologia komputerowa, to przecież “pamięć”. Już w latach 40. rozpowszechnił jej użycie John van Neumann, który w swojej architekturze sformalizował podział na procesor i jednostkę pamięci (memory unit). Równie dobrze mógł ją nazwać retencją albo bulbulatorem. Wybrał jednak - zapewne na zasadzie analogii - pamięć, mimo że pamięć u maszyn działa inaczej niż pamięć u ludzi.

Wydaje mi się, że na podobnej zasadzie powstały dzisiejsze terminy dotyczące sztucznej inteligencji, które nawiązują do cech mentalnych u żywych organizmów. Na przykład:

-

Sieci neuronowe - w rzeczywistości są to warstwy matematycznych wag, ale na poziomie koncepcji widzimy je jako połączone ze sobą neurony przesyłające impulsy z danymi

-

Uczenie (learning), głębokie uczenie, trening - optymalizacje skomplikowanych funkcji matematycznych i dostrajania ich do danych porównujemy do uczenia się np. na klasówkę

-

Halucynacje - błędy w przewidywaniu kolejnych najbardziej prawdopodobnych słów utożsamiamy z poważnymi zaburzeniami funkcji poznawczych

-

Crème de la crème, czyli…

Inteligencja

Metafora „inteligencji” i jej derywatów to chyba najpotężniejszy chwyt marketingowy w historii technologii. Trudno uwierzyć, że jest on używany już dobre pół wieku.

Termin “Artificial Intelligence” zapronowł John McCarthy w 1956 roku, podczas słynnych warsztatów w Dartmouth poświęconych “thinking machines”. Możliwe, że wybrał AI, bo brzmiała lepiej niż badziej adekwatne alternatywy, takie jak Complex Information Processing. Wraz z rozwojem technologii okazało się, że wybór był marketingowo doskonały, ale na poziomie samej koncepcji bardzo mylący.

W informatyce “inteligencję” definiuje się bardzo wąsko: jako zdolność systemu do poprawnego przetworzenia danych i wykorzystania ich do osiągania konkretnych, zdefiniowanych w programie celów. W kontekście AI inteligencja to głównie optymalizacja. Jeśli algorytm znajdzie najkrótszą drogę w labiryncie lub trafnie przewidzi następne słowo w zdaniu, nazywamy go „inteligentnym”, chociaż jest to zdolność bardzo wyspecjalizowana i czysto matematyczna.

Zastosowanie słowa „inteligencja” w nazwie nowej technologii otworzyło jednak na oścież furtkę do tego, żeby mówić o niej w kontekście jej domniemanej podmiotowości i autonomii. W ten absurd dalej ochoczo brniemy, nadbudowując nad nim kolejne warstwy skojarzeń i metafor.

Sprawę dodatkowo komplikuje fakt, że “inteligencja” w potocznym tego słowa znaczeniu to pojęcie wybitnie rozmyte. Nie jest tak jednoznaczną cechą jak wzrost, który można łatwo zmierzyć i podać w odpowiedniej jednostce.

W kontekście ludzi “inteligencja” może więc oznaczać rozmaite rzeczy, np. umiejętność rozwiązania trudnego sudoku albo testu IQ. Może też charakteryzować kogoś, kto umie rozpoznawać emocje (inteligencja emocjonalna) albo sprawnie posługuje się ironią. Niektórzy wyróżniają (8 i więcej odmian) inteligencji, jeszcze bardziej rozcieńczając i tak już wątłe znaczenie tego terminu.

W zasadzie jednak “inteligencja” najczęściej odnosi się do Golema ulepionego z indywidualnych wyobrażeń na temat tego, co to właściwie oznacza być inteligentnym. Zlewa się w jedno z takimi cechami jak spryt, mądrość, dowcip, bystrość, błyskotliwość, oczytanie i obycie, rozległa wiedza. All inclusive, bierz co chcesz. Albo co akurat ci pasuje.

Mamy więc na poziomie nazewnictwa AI całkiem głębokie semantyczne bagno. Wiemy, że jest inteligencją, cokolwiek to znaczy w kontekście maszyn. Wiemy też, że jest sztuczna. Gdyby więc ktokolwiek kwestionował jej walory i zasugerował, że jest czymś innym niż inteligencja u ludzi, to zawsze można odeprzeć takie zarzuty przez wskazanie jej “sztucznego” charakteru. Trudno z tym dyskutować.

Duch w maszynie

Antropomorfizacja w kontekście AI to nie tylko to, co związane jest z samą sferą mentalną. W odsłonie agentowej metafory czerpią z rozmaitych dziedzin, nawet tak nietypowych dla terminologii IT, jak mistycyzm. Najlepszym tego przykładem są Dusze, czyli pliki typu Soul. Tomasz z Akwinu lubi to.

Soule to pliki w formacie Markdown. Zawierają napisane językiem naturalnym dyrektywy, które definiują zachowanie agenta. Sekcje pliku mogą zawierać atrybuty takie jak:

- Core Truths - zasady, które kierują działaniem agenta, np. „Nie wprowadzam w błąd. Jeśli czegoś nie wiem, przyznaję się do tego”

- Boundaries - wyzaczają granice, których agent nie może przekroczyć, np. “Nie udzielam porad medycznych”

- Vibe - to właściwie opis “osobowości” agenta, np. “Ironiczny, ale pomocny ekspert”

- Example Interaction - scenariusze rozmów pokazujące, jak agent powinien się zachowywać w praktyce

- Communication Style - sposób formułowania wypowiedzi, np. “Krótko i na temat, bez emotikonów”.

Widzicie to, nie? Ten mix losowych terminów wyjętych z templatki do ocen rocznych w korpo i podręcznika do filozofii. A to nie wszystko. W zależności od implementacji i własnej fantazji można do Soul.md dodać jeszcze cały szereg innych atrybutów takich jak: Goals, Anti-Goals, Decision Rules, Persona, Knowledge Scope, Tone Guardrails, Failure Mode, Context Awareness, Constraints. Google Agent Development Kit też w swoich instrukcjach stawia na “personalities” i “persony” swoich agentów.

Soul.md to próba zaszczepienia namistki osobowości na modelu stochastycznym. Niemniej dzięki niemu możemy osiągnąć względne poczucie stałości w promptowaniu, bo model czyta ten plik na początku każdej konwersacji i konsekwentnie realizuje zawarte w nim wytyczne. Takie “dusze” możesz sobie napisać, ale możesz też ściągnąc z repozytriów dusz.

W dobrym “vibie” jest też mówienie o “odpowiedzialnym” i “etycznym” AI. Biorę nazwy z cudzysłów, bo przypisywanie programom cech moralnych, co samo w sobie wydaje mi się trochę niemoralne - mówimy przecież o etyce zaawansowanego kalkulatora. Jednak twórcy LLM-ow idą w zaparte i wmawiają nam, że za tą technologią podąża jakiś system wartości, czego przezabawnym przykładem jest Konstytucja Claude’a. Zdejmuje to niejako z nich odpowiedzialność za wiele niezbyt chwalebnych zjawisk, które idą krok w krok z rozwojem sztucznej inteligencji, takich jak np. kradzież całego internetu czy drenaż zasobów naturalnych potrzebnych pod budowę i działanie kolejnych centrów obliczeniowych.

Pochwała głupoty

Ludzie potrafią z bardzo małej ilości informacji stworzyć wyjaśnienie obserwowanych zjawisk. Posługują się w tym celu uogólnieniemi, logiką, zebraną wiedzą i doświadczeniem. AI przeciwnie. Stanowi ogromne lustro danych wyprodukowanych przez ludzkość. Na ich podstawie tworzy potencjalne wyjaśnienia, które nie muszą mieć pokrycia w rzeczywistości - jeśli je mają, to jedynie na zasadzie dobrze wykonanego rzutu w statystycznej ruletce. W niektórych dziedzinach, szczególnie tych, które miały dużą reprezentację pisaną, AI radzi sobie świetnie. Tak świetnie, że daje ułudę rozmowy z wybitnie uzdolnioną, inteligentną jednostką. W innych dziedzinach z kolei leży i kwiczy. Robi podstawowe błędy, myli się, bredzi, kluczy.

Wpisuje się to idealnie w tzw. paradoks Moraveca. W latach 80. Hans Moravec, Marvin Minsky i Rodney Brooks zauważyli, że wysokopoziomowe operacje umysłowe (np. gra w szachy, dowodzenie twierdzeń matematycznych) wymagają stosunkowo niewielkiej mocy obliczeniowej. Z kolei niskopoziomowe zdolności percepcyjne i motoryczne (np. skakanie, manipulacja przedmiotami) – uważane za łatwe do opanowania i pojawiające się u ludzi na bardzo wczesnym etapie rozwoju – wymagają ogromnych zasobów. AI może więc z łatwością pokonać człowieka w grze w szachy, ale mobilność rocznego dziecka jest na razie poza jej zasięgiem. Ludzie dostają takie podstawowe umiejętności w pakiecie z genami jako efekt milionów lat ewolucji. Wykonujemy je bezrefleksyjnie, przez co wydają się bezwysiłkowe. A nie są. Po prostu mamy je już “zaembeddowane” w naszym hardwarze i nie musimy co chwila odtwarzać całego procesu ich uczenia.

A jednak to ta wysokopoziomowa inteligencja jest u ludzi traktowana wręcz jako fetysz i kojarzona jednoznacznie pozytywnie. Jej deficyt sprowadza się do stwierdzenia: jesteś głupi. A nikt nie chce być uważany za przygłupa, co nie?

Wydaje mi się, że właśnie z tego powodu tak doskonałym chwytem jest AI na poziomie nazewnictwa. Obcując ze sztuczną inteligencją sami czujemy się mądrzejsi i jacyś tacy bardziej nobliwi. Wierzymy jej, bo sprawia wrażenie, że świetnie nas rozumie. Cieszy nas, jak zauważymy jej błędy, bo dobrze nam to robi na poczucie własnej wartości i wiarę we własną inteligencję.

I tutaj dochodzimy do paradoksu. Z jednej strony uosabiamy AI jako bezbrzeżną krynicę wiedzy. Z drugiej strony dajemy jej wyjątkowy benefit of the doubt, którego nie dalibyśmy żadnej innej popularnej technologii. Pozwalamy jej na kompromitujące halucynacje i ochoczo je wybaczamy. Wpisujemy je wręcz w istotę AI, chociaż niby “mylić się jest rzeczą ludzką”. Czyli znowu: mierzymy technologię swoją miarą i antropomorfizujemy.

Wzloty i upadki LLM-ów

Skończmy jednak z teorią. W praktyce LLM-y są zajebiste.

Obecnie jestem aktywnym użytkownikiem kilku modeli w ich wersjach freemium. Używam ich prywatnie i w pracy mimo, że zdarzały się przypadki, że dostawałam od nich odpowiedzi wyjęte posto z cyfrowej pizdy. Jednak mogę otwarcie przyznać, że nie wyobrażam już sobie życia bez AI. Piszę to z pewną nostalgią, bo jeszcze niedawno moimi podstawowymi źródłami wiedzy były Wikipedia i StackOverflow. Obecnie zaglądam na te portale sporadycznie, bo wszystko dostaję od razu w aplikacji modelu lub w wyszukiwarce z trybem AI. Trochę odbiera to poczucia sprawczości i rozleniwia. Sprawia ponadto, że w swoich poszukiwania w sieci zaczęłam myśleć promptami, a nie słowami kluczowymi, jak to drzewiej bywało.

Podsumowując: tego pierdnięcia nie da się z powrotem wpuścić do dupy. AI zostanie z nami nie tylko dlatego, że jest to przełomowa technologia, na której rozwój spalono gigantyczną kasę i zasoby. Zostanie z nami, bo realnie zmienia świat, dla każdego w inaczej i w innym stopniu. Wpływa na to, jak ludzie funkcjonują i w jakich warunkach żyją. Pamiętajmy bowiem, że centra obliczeniowe dla LLM-ów to energetyczna studnia bez dna. Zużywają gigantyczne ilości prądu, a do ich chłodzenia potrzebne są niespożyte zasoby wody, która może w niedługim czasie stać się naszym największym bogactwem, którego nijak nie wypromptujemy.

Ten aspekt obecnego pochodu AI przez świat jest naprawdę przerażający. Na koniec wracam więc do Barbary Ehrenreich. Czytajcie jej książki. Oprócz przywołanej już “Z przyczyn naturalnych” polecam też sięgnąć po “Gdybym wiedziała” oraz “Za grosze. Pracować i (nie) przeżyć”. Obie pozycje pozwalają wyjąć główę z własnej banieczki i spojrzeć na świat, który upada wraz z Eldorado.